CONTEÚDO DAS AULAS

Conceitos básicos

1) Introdução a Machine Learning e IA

2) Viés e variância de modelos (teoria)

3) Visão geral dos algoritmos de machine learning

Regressão Linear

4) Regressão linear (conceito + matemática: o que o algoritmo faz debaixo dos panos)

5) Regressão linear (aplicação prática em Python: resolvendo um problema – Parte I)

6) Regressão linear (aplicação prática em Python: resolvendo um problema – Parte II)

7) Regressão linear (apresentação do exercício)

8) Regressão linear (solução do exercício)

9) Random State na divisão entre treino e teste

Pré-processamento

10) Pré-processamento: adequação dos tipos de dados (int, float, str…)

11) Pré-processamento: dados missing

12) Pré-processamento (exercício & solução)

13) Feature selection: correlação

14) Correlação (exercício & solução)

Outros Modelos de Regressão Linear

15) Ridge regression (conceito + matemática: o que o algoritmo faz debaixo dos panos)

16) Ridge regression (aplicação prática em Python: resolvendo um problema)

17) Regularização L1, L2 e regressão Lasso

18) Lasso regression (aplicação prática em Python: resolvendo um problema)

19) Elastic net (conceito + matemática: o que o algoritmo faz debaixo dos panos)

20) Elastic net (aplicação prática em Python: resolvendo um problema)

21) Comparando diferentes modelos em um único código

22) Escolha de um modelo de regressão (apresentação do exercício)

23) Escolha de um modelo de regressão (solução do exercício)

Validação Cruzada e Ajuste Fino dos Parâmetros

24) Validação cruzada Kfold (teoria: o que o algoritmo faz debaixo dos panos)

25) Validação cruzada Kfold (aplicação prática em Python)

26) Validação cruzada Kfold (solução do exercício)

27) Validação cruzada StratifiedKFold (teoria)

28) Como calibrar os parâmetros para aumentar a performance de um modelo

29) Função Randomized Search (teoria e aplicação prática em Python)

30) Função GridsearchCV (teoria e aplicação prática em Python)

Regressão Logística

31) Regressão logística (conceito + matemática: o que o algoritmo faz debaixo dos panos)

32) Regressão logística (aplicação prática em Python: resolvendo um problema)

33) Regressão logística (ajuste fino de parâmetros)

34) Regressão logística (apresentação do exercício)

35) Regressão logística (solução do exercício)

Confusion Matrix e Normalização

36) Medição de desempenho Confusion Matrix (teoria e prática)

37) Medição de desempenho ROC/AUC (conceito + matemática: o que o algoritmo faz debaixo dos panos)

38) Medição de desempenho ROC/AUC (aplicação prática em Python)

39) Pré-processamento: normalizando dados em Python (utilizando as funções Normalizer, MinMaxScaler, StandardScaler, MaxAbsScaler)

KNN

40) KNN (conceito + matemática: o que o algoritmo faz debaixo dos panos)

41) KNN (aplicação prática em Python: resolvendo um problema)

42) KNN (ajuste fino de parâmetros)

43) KNN (apresentação do exercício)

44) KNN (resolução do exercício)

Naive Bayes

45) Teorema de Bayes (conceito teórico)

46) GaussianNB, MultinomialNB, BernoulliNB (o que os algoritmos Naive Bayes fazem debaixo dos panos)

47) Suavização de Laplace

48) Naive Bayes (aplicação prática em Python: resolvendo um problema)

49) Naive Bayes (apresentação do exercício)

50) Naive Bayes (solução do exercício)

Decision Trees

51) Decision Trees (conceito + matemática: o que o algoritmo faz debaixo dos panos) – Parte 1: entropia

52) Decision Trees (conceito + matemática: o que o algoritmo faz debaixo dos panos) – Parte 2: índice GINI

53) Decision Trees: evitando overfitting

54) Decision Trees (conceito + matemática: o que o algoritmo faz debaixo dos panos) – Parte 3: regressão

55) Decision Trees (conceito + matemática: o que o algoritmo faz debaixo dos panos) – Parte 4: a escolha do melhor split com algoritmos CART e C4.5

56) Decision Trees Classifier (aplicação prática em Python: resolvendo um problema)

57) Decision Trees Classifier (mostrando a árvore com graphviz)

58) Decision Trees Classifier (ajustando os parâmetros)

59) Decision Trees Regressor (aplicação prática em Python: resolvendo um problema)

60) Decision Trees Regressor (ajustando os parâmetros)

61) Decision Trees (apresentação do exercício)

62) Decision Trees (resolução do exercício)

63) Escolhendo outros tipos de scoring

Feature Selection

64) Pré-processamento: one hot encoding e concatenação

65) Pré-processamento: outliers

66) Feature selection: qui-quadrado (conceito + matemática: o que o algoritmo faz debaixo dos panos)

67) Feature selection: qui-quadrado (aplicação prática em Python)

68) Feature selection: f_classif (conceito + matemática: o que o algoritmo faz debaixo dos panos)

69) Feature selection: f_classif (aplicação prática em Python)

70) Feature selection: eliminação recursiva (aplicação prática em Python)

71) Como acelerar o processamento de um algoritmo no seu computador

Testando seus conhecimentos

72) Apresentando o exercício prático final

73) Solução do exercício prático final

74) Bônus

75) Teste dos seus conhecimentos teóricos

EXERCÍCIOS

Muitos exercícios foram elaborados para você colocar em prática tudo o que está aprendendo ao longo do curso. Você irá rodar modelos de machine learning nos seguintes conjuntos de dados:

- Admissão de estudantes em processo seletivo

- Diagnóstico de doença na coluna

- Diagnóstico de câncer de mama

- Classificação de tipos de flores

- Escolha de desodorante

- Classificação de tipo de fermentação de cerveja

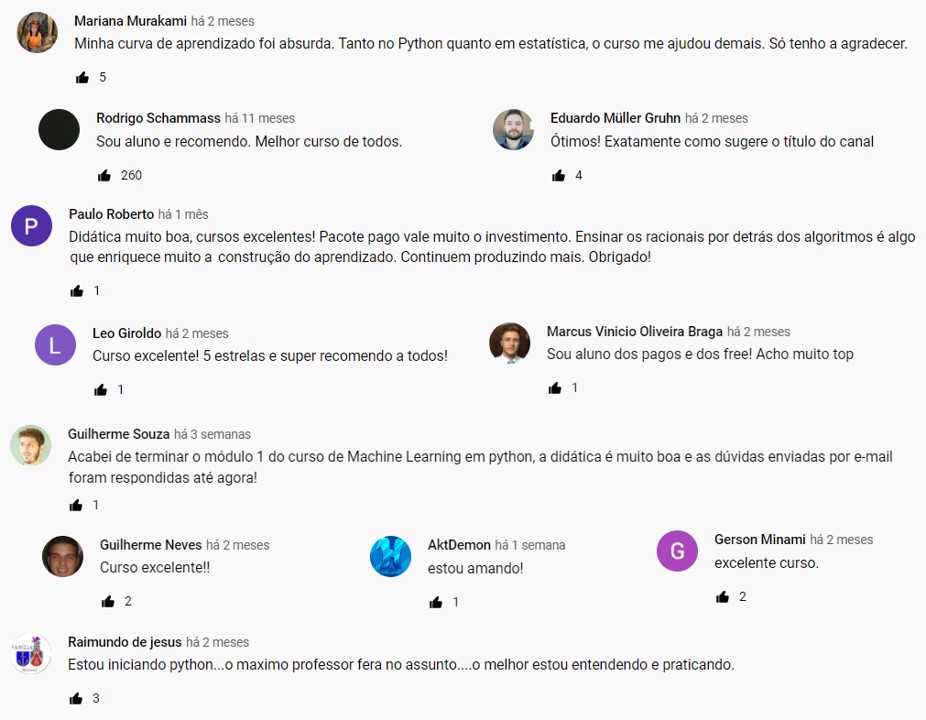

O QUE OS ALUNOS ESTÃO DIZENDO?